300亿的星环科技贵不贵——写在AI推理爆发前夜

“摩尔定律已死”——老黄喊出的这句话,让我想起了2018年万科郁亮喊出的那句“活下去”,行业头部玩家的“惊世之言”,往往预示着行业根本性拐点的到来。

两者不同之处在于,“活下去”是房地产行业由盛转衰的无奈哀鸣,“摩尔定律已死”却是英伟达从训练转向加速计算和AI驱动新范式的进攻号角。

当GPT、Claude、Deepseek、GLM-5等等大模型已足够聪明,并且受限于摩尔定律,我们无法让它们变得更聪明的时候,让它们变得更懂你,就成了亟需解决的关键问题。

试想一下,当豆包有了记忆,会是怎样的情形——它记得你喜欢的咖啡温度、共情你的喜怒哀乐、钻研你关注的专业领域,成为独属于你的私人管家、生活老友和研究伙伴。

要实现上述情景,就得给AI装上记忆大脑,既要有短期记忆(上下文推理、即时响应速度),又要有长期记忆(用户历史问题和习惯集中储存,迅速调用)。

要让新装的记忆大脑不产生“排斥反应”,就得对原来基于CPU的存储架构进行彻底革新,而这,就是英伟达联合星环科技正在做的事。

下面,我从技术角度给大家盘一盘为啥要改架构。

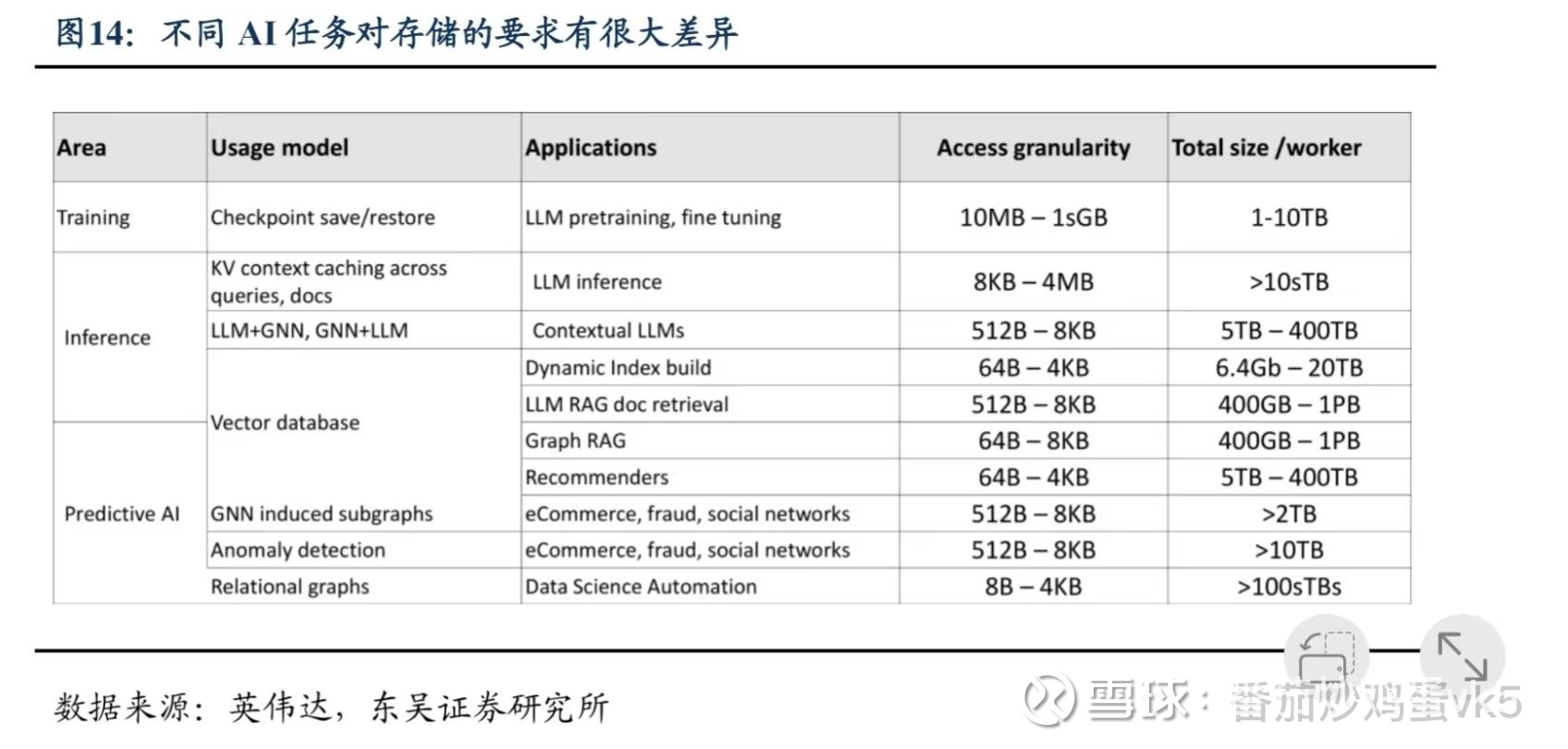

AI训练依赖大量数据的批量传输,单轮数据块尺寸在MB级以上,但是AI推理完全不同,缓存访问粒度仅8KB-4MB,向量数据库检索、推荐系统的特征读取更是低至64B-8KB,但需要支持千条并行线程的并发请求,总量更是突破TB级。

为方便理解,我们把CPU比作服务器的经理,GPU比作服务器的熟练工。在训练时代,经理负责分发大尺寸数据块,打包给熟练工,熟练工处理完后再交给经理出货,所以容量和吞吐量是评判服务器效率的关键。到了推理时代,最大的特点是货小、但总量多,如果再让经理去分发数据,就会有大量的熟练工闲着没事干,造成服务器的效率低下和算力浪费。

所以英伟达提出了GPU直连SSD存储架构,在这个架构中,GPU绕过CPU直接调取数据进行处理,CPU从经理变成了监工,服务器处理数据的效率瞬间提高。

这一历史性的存储架构的硬件革新,数据库(负责存储、调用数据的软件)也需要围绕GPU的数据获取和处理能力重新设计,进行深度架构改造,而改造后的数据库软件,也摇身一变,从一个通用操作系统上运行的、管理磁盘文件的应用程序,变成直接调度和管理GPU、SSD计算和存储硬件的“数据中心级操作系统内核”。

目前已经实现改造的,全球范围内只有星环科技一家,看清楚,是全球。

所以你觉得300亿的星环科技贵吗?不仅不贵,是太踏马便宜了。

如果GPU直连SSD存储架构广泛推广(目前看是大概率事件),凭借先发优势和英伟达生态体系,星环科技面对的是一个千亿美元的市场,做的是毛利60%以上的暴利铲子生意,市值后面再挂个零才配得上它的卡位优势。当然,以上只是我们看到的还没落地的星辰大海,至于星环能不能顺利抵达还有很多不确定性,小伙伴们可别上头去打板,不构成投资建议哈![]()