陈肉肉kyrie

· 福建

$星环科技-U(SH688031)$

存储,才是AI推理真正的瓶颈

“GPU越来越快,但数据喂不进去,这是AI推理时代最贵的堵车。

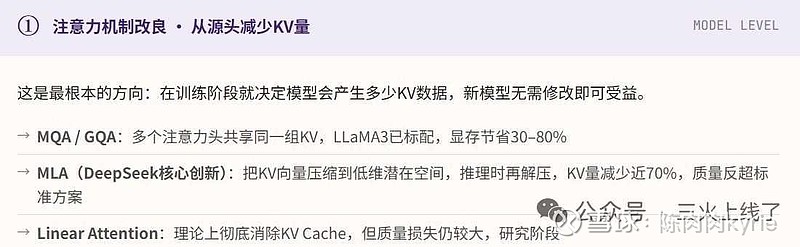

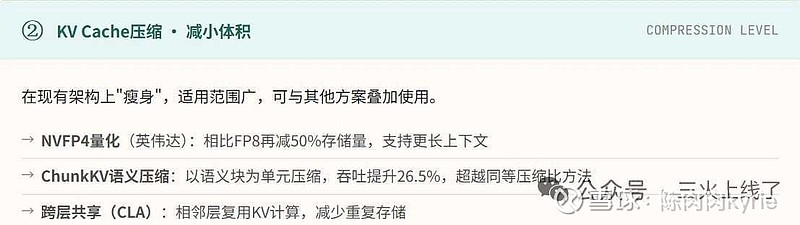

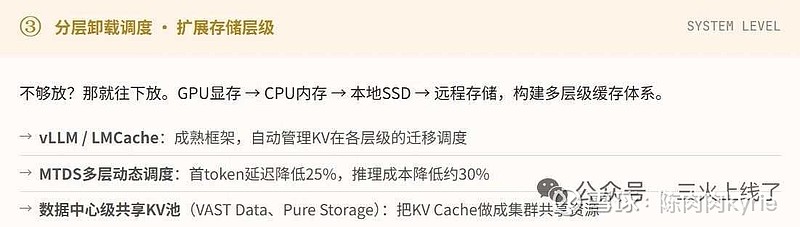

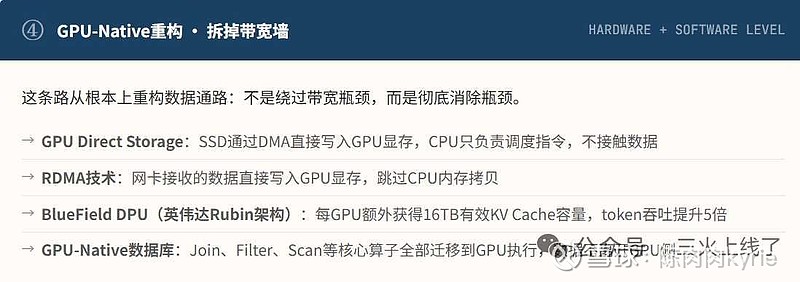

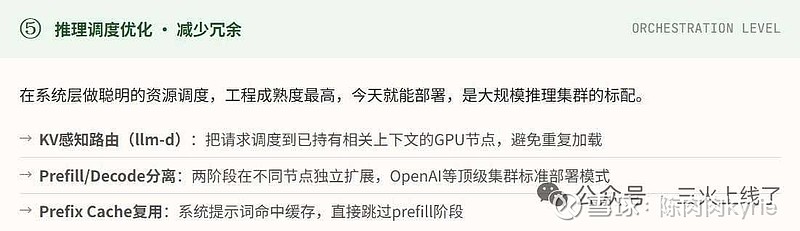

解决推理瓶颈,有五条路;但只有一条路,能把墙拆掉。GPU Native数据库,是在为AI时代重建存储的地基。”

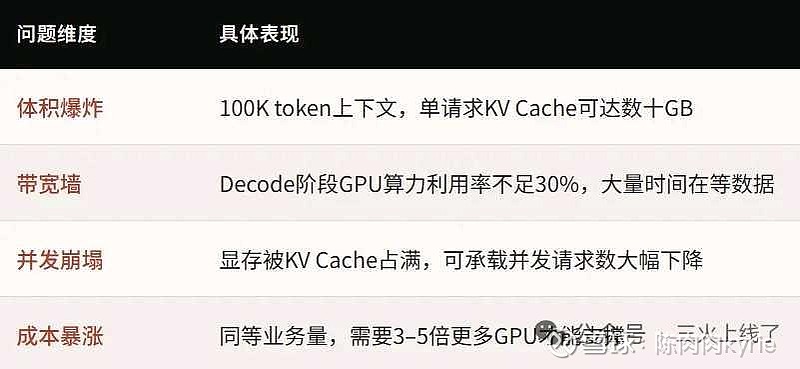

一、问题:AI推理时代最贵的堵车

想象一下:你花了几亿买了一批最先进的跑车(GPU),结果发现路只有一车道(内存带宽),跑车再快也没用。

这就是今天AI推理面临的真实困境。GPU的算力每18个月翻一倍,但数据进出的通道,内存带宽,远远跟不上。

什么是KV Cache?

大语言模型在生成文字时,每生成一个词(token),都要回头看一遍此前所有的对话记录。这个"记忆"就存储在一个叫 KV Cache(键值缓存) 的结构里。上下文越长,KV Cache越大,问题越严重。

黄仁勋在2026年CES大会说:“存储,必须被重构。”

这不是技术人的自娱自乐,而是产

点击查看全文