闪电考拉

· 韩国

谷歌在2026年3月24日发表TurboQuant论文,解决大型语言模型推理时,KV缓存的内存瓶颈问题,大幅节省长上下文时的KV缓存,普通设备笔记本也能跑大模型的长上下文,但是谷歌代码还要等下个季度才能放出来。

Tom Turney是前谷歌员工(Xoogler),专注本地AI推理。

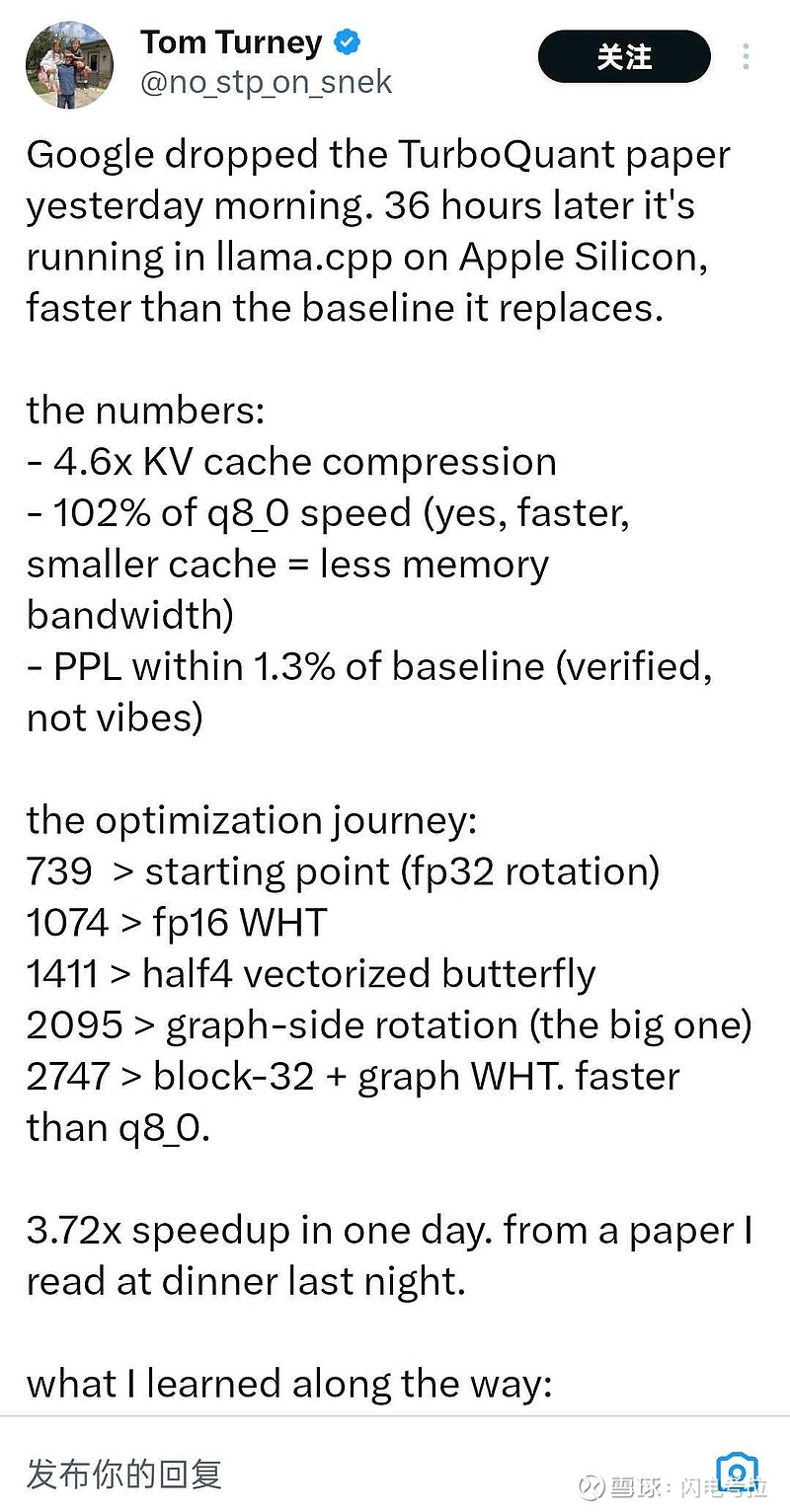

他花36小时读完谷歌论文,并用Claude辅助解析复杂推导,写核心算法,搭141个单元测试,跑通Python原型。

然后花几天时间移植到llama.cpp(龙虾),还做了工程优化以及部分创新。

总耗时不到7天就把大厂几个月工程团队的工作干完了。实测Qwen3.5 35B能够在M5 Max MacBook流畅运行。

有了AI加持,个人淘金热又可以兴起了。

这对内存股不是利空,是利好,软件总是能不断优化硬件消耗,这意味着总需求将无限放大。