SkyReels系列开源模型HuggingFace下载量超25万

2025年,昆仑万维(300418)陆续发布并开源多个SkyReels模型。截至目前,SkyReels系列开源模型在HuggingFace中的累计总下载量超25万次、GitHub stars累计超8k,它们获得开源社区、海内外AI机构组织、科研学者等AI从业者和开发者的广泛关注与喜爱。

1

SkyReels-V1模型

其中,SkyReels-V1模型是最早和用户见面的SOTA级开源模型。作为中国首个面向AI短剧创作的、以人为中心的开源视频生成模型,SkyReels-V1的核心是提升表情生成、肢体生成的可控表演效果。

其不仅针对表演细节做了打标,还对情绪、场景、表演诉求等进行处理,利用千万级别、高质量的好莱坞级别数据进行训练微调。因此,SkyReels-V1可实现影视级人物微表情表演生成,支持33种细腻人物表情与400+种自然动作组合,高度还原真人情感表达。

更重要的是,SkyReels-V1不仅是国内最早支持文生视频(T2V)、还能支持图生视频(I2V)的模型,也是上半年中开源视频生成模型中参数最大的支持图生视频的模型,在同等分辨率下各项指标实现开源SOTA。

SkyReels-V1 开源地址:

https://huggingface.co/collections/Skywork/skyreels-v1-67b34676ff65b4ec02d16307

2

SkyReels-V2模型

紧随其后,2025年4月,昆仑万维SkyReels团队正式发布并开源SkyReels-V2模型——全球首个使用扩散强迫(Diffusion-forcing)框架的无限时长电影生成模型。SkyReels-V2模型的核心价值在于,其为实现高质量、长时间的电影风格视频生成提供了全新的解决方案。

截至目前,SkyReels-V2累计收获GitHub stars 4.4k,位列GitHub “Awesome Video Diffusion”模型合辑。

SkyReels-V2模型不仅通过结合多模态大语言模型(MLLM)、多阶段预训练(Multi-stage Pretraining)、强化学习(Reinforcement Learning)和扩散强迫(Diffusion-forcing)框架来实现协同优化,还提供多了多种有用的应用场景,包括故事生成、图生视频、运镜专家和多主体一致性视频生成。

SkyReels-V2(1.3B、14B等多尺寸)开源地址:

https://huggingface.co/collections/Skywork/skyreels-v2-6801b1b93df627d441d0d0d9

3

SkyReels-A1模型

SkyReels-A1则是中国首个开源的SOTA级别基于视频基座模型的表情动作可控算法,它能够基于任意人体比例(包括肖像、半身及全身构图)生成高度逼真的人物动态视频,其真实感源自对人物表情变化和情绪的精准模拟、皮肤肌理、身体动作跟随等多维度细节的深度还原。

SkyReels-A1支持和驱动下的人物表演,不仅人物不失真,且表演细节更真实,还可以实现神情与身体动作的自然完美融合,同时能够实现更大幅度的人物表情驱动。以SkyReels-A1为代表的可控算法开源后,有望为用户带来低成本、可控性更强的AIGC能力。

SkyReels-A1:

项目主页:

https://skyworkai.github.io/skyreels-a1.github.io/

开源地址:

https://huggingface.co/Skywork/SkyReels-A1

4

SkyReels-A2模型

SkyReels-A2是昆仑万维开源的可控视频生成框架,可以根据文本提示将任意视觉元素(如人物、物体、背景等)组装成合成视频,同时严格保持每个元素与参考图像的一致性。

这意味着,用户可以同时上传多个元素来组合生成一段视频,并通过提示词控制来生成视频的准确度,SkyReels-A2解决了多个主体一致性生成视频一致性的问题,大幅提升了视频生成可控性。

为达到这样的效果,SkyReels-A2设计了一种新的图像-文本联合嵌入模型,将多元素表示注入生成过程中,平衡元素特定的一致性与全局连贯性以及文本对齐。

SkyReels-A2:

项目主页:

https://skyworkai.github.io/skyreels-a2.github.io/

开源地址:

https://huggingface.co/Skywork/SkyReels-A2

5

SkyReels-A3模型

8月11日,SkyReels-A3模型发布(未开源),基于“DiT(Diffusion Transformer)视频扩散模型+插帧模型进行视频延展+基于强化学习的动作优化+运镜可控”,其能实现任意时长的全模态音频驱动数字人创作。

SkyReels-A3 项目主页:

https://skyworkai.github.io/skyreels-a3.github.io/

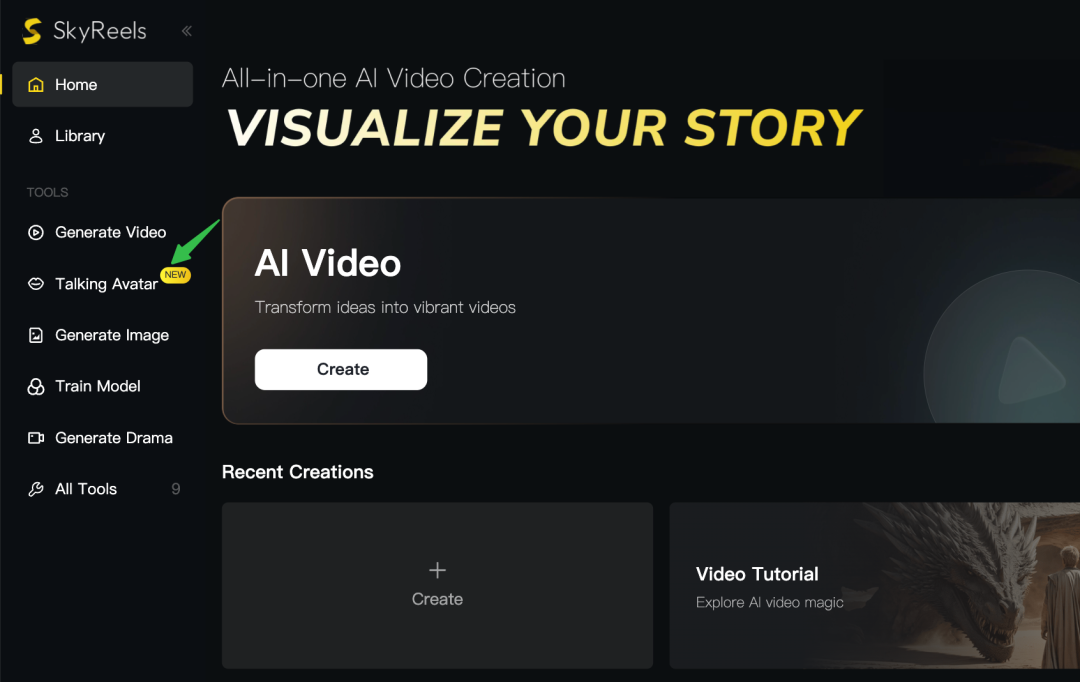

用户可以直接登录SkyReels官网,在左侧导航栏中选择Talking Avatar工具后直接使用。

作为音频驱动(audio-driven)人像视频生成模型,SkyReels-A3就像给任意照片或视频装上“AI声带”:

SkyReels-A3模型功能

让一张照片“活”起来:上传一张人像图片,再配段语音,照片里的人就能按这段语音开口说话或唱歌;

创作一段新的视频:上传一张人像图片、配段语音,再给出文字prompt,照片里的人就能按照要求的状态进行表演;

给现有视频“改台词”:可以将原视频的音频换掉,人物会自动对上新的口型、表情和表演,画面依旧连贯。

6

以开源之姿,

昆仑万维SkyReels助力全球AI视频创作生态繁荣发展

昆仑万维始终坚守开源理念、积极拥抱AI开源,致力于推动AI技术的开放共享与社区共建。

当前,昆仑万维自研并发布了天工语言大模型、天工多模态大模型、SWE代码大模型、Agent大模型、视频大模型、3D大模型、音乐大模型、音频大模型等8个大模型。

2025年以来,SkyReels陆续开源多个SOTA级别视频生成模型和算法、通用模型,希望通过开源实现AGI平权,推动AI视频创作生态的持续建设和繁荣,促进开源社区、开发生态以及AI行业的发展。

欢迎开发者与用户下载SkyReels开源模型,或登陆SkyReels官网体验模型功能。

SkyReels官网地址:

https://www.skyreels.ai/official/